- 你的位置:开云「中国」Kaiyun官网登录入口 > 资讯 > 开云「中国」Kaiyun官网登录入口并试验神经集聚来展望这些被避讳像素的值-开云「中国」Kaiyun官网登录入口

开云「中国」Kaiyun官网登录入口并试验神经集聚来展望这些被避讳像素的值-开云「中国」Kaiyun官网登录入口

这里有一项针对婴儿的测试:给他们看桌上的一杯水。把水藏在一块木板后头。然后把木板移向水杯。淌若木板一直经过水杯,就好像水杯不存在通常,他们会感到骇怪吗?好多六个月大的婴儿皆会感到骇怪,到一岁时,着实通盘孩子皆融会过不雅察,对物体的握久性产生直观。当今开云「中国」Kaiyun官网登录入口,一些东谈主工智能模子也具备这种材干。

究诘东谈主员修复了一种东谈主工智能系统,它不错通过视频了解寰宇,并在呈现与其所集聚的学问违反的信息时发扬出“骇怪”的嗅觉。

该模子由 Meta 创建,名为“视频伙同镶嵌展望架构”(V-JEPA),它分愤激频中包含的寰宇的物理特色作念出任何假定。尽管如斯,它仍然不错意会寰宇的运作模样。

Micha Heilbron示意:“他们的说法从表面上来说格外合理,并且服从格外深嗜深嗜深嗜深嗜。”(怒放新标签页)是阿姆斯特丹大学的领略科学家,究诘大脑和东谈主工系统何如意会寰宇。

更高眉目的抽象正如自动驾驶汽车的工程师们所知,让东谈主工智能系统可靠地意会它所看到的内容并非易事。大多量旨在“意会”视频的系统,要么对视频内容进行分类(举例,“一个东谈主在打网球”),要么识别物体的轮廓(举例,前哨有一辆车),它们在所谓的“像素空间”中使命。这些模子施行上将视频中的每个像素皆视为同等垂危。

但这些像素空间模子存在局限性。念念象一下,试图意会一条郊区街谈。淌若场景中有汽车、交通讯号灯和树木,模子可能会过于关切不有关的细节,举例树叶的指点。它可能会错过交通讯号灯的模样或隔邻汽车的位置。“当你处理图像或视频时,你不会念念在[像素]空间中使命,因为有太多你不念念建模的细节,”兰德尔·巴莱斯特里罗说。(怒放新标签页)布朗大学预见机科学家。

纽约大学预见机科学家、Meta 东谈主工智能究诘主任 Yann LeCun 于 2022 年创建了 JEPA,它是 V-JEPA 的前身,用于处理静态图像。

巴黎萨克雷概述理工大学

2024 年发布的 V-JEPA 架构旨在幸免这些问题。天然组成 V-JEPA 的各式东谈主工神经集聚的具体细节很复杂,但其基本成见却很浅薄。

平凡的像素空间系统会履历一个试验流程,包括避讳视频帧中的某些像素,并试验神经集聚来展望这些被避讳像素的值。V-JEPA 也会避讳部分视频帧。但它不会在单个像素的层面上展望避讳区域背后的内容。相反,它使用更高眉目的抽象,或“潜在”示意,来对内容进行建模。

潜在表征仅拿获数据的基本细节。举例,给定各式圆柱体的线条图,一个称为编码器的神经集聚不错学习将每幅图像改革为代表每个圆柱体基本特征的数字,举例其高度、宽度、标的和位置。通过这种模样,数百或数千个像素中包含的信息被改革成几个数字——即潜在表征。然后,一个称为解码器的孤苦神经集聚学习将圆柱体的基本细节改革为圆柱体的图像。

“寰宇模子”——东谈主工智能限制的一个陈旧成见——卷土重来

东谈主工智能“寰宇模子”——东谈主工智能限制的一个陈旧成见——卷土重来

V-JEPA 专注于创建和重现潜在表征。从高眉目来看,该架构分为三个部分:编码器 1、编码器 2 和展望器。率先,试验算法取得一组视频帧,在通盘帧中屏蔽调换的像素集,然后将这些帧输入编码器 1。只怕,视频的终末几帧会被整个屏蔽。编码器 1 将这些屏蔽的帧改革为潜在表征。该算法还将未屏蔽的帧完好意思地输入编码器 2,编码器 2 将它们改革为另一组潜在表征。

当今,展望器运转领悟作用。它使用编码器 1 生成的潜在示意来展望编码器 2 的输出。施行上,它袭取由掩码帧生成的潜在示意,并展望由未掩码帧生成的潜在示意。通过重建有关的潜在示意,而不是早期系统中缺失的像素,模子学会了识别谈路上的车辆,而不是关切树叶。

昆汀·加里多 (Quentin Garrido)示意:“这使得模子约略丢弃无须要的信息,并专注于视频中更垂危的方面。”(怒放新标签页),Meta 的究诘科学家。“丢弃无须要的信息格外垂危,这亦然 V-JEPA 旨在高效完成的事情。”

预试验阶段完成后,下一步是对 V-JEPA 进行定制,使其约略完成特定任务,举例对图像进行分类或识别视频中状貌的手脚。此妥贴阶段需要一些东谈主工象征的数据。举例,视频必须添加与其所含手脚有关的象征信息。比较于针对特定下流任务对通盘这个词系统进行端到端试验,最终任务所需的象征数据要少得多。此外,调换的编码器和展望器集聚不错妥贴不同的任务。

直观效法者本年 2 月,V-JEPA 团队论说称(怒放新标签页)他们的系统何如意会现实寰宇的直不雅物理属性——举例物体的永久性、情势和模样的恒定性,以及重力和碰撞的影响。在一项名为“IntPhys”的测试中(怒放新标签页)需要东谈主工智能模子来识别视频中发生的手脚是否合适物理逻辑,V-JEPA 的准确率接近 98%。而一个著明的像素空间展望模子的准确率也只比立地概率高极少点。

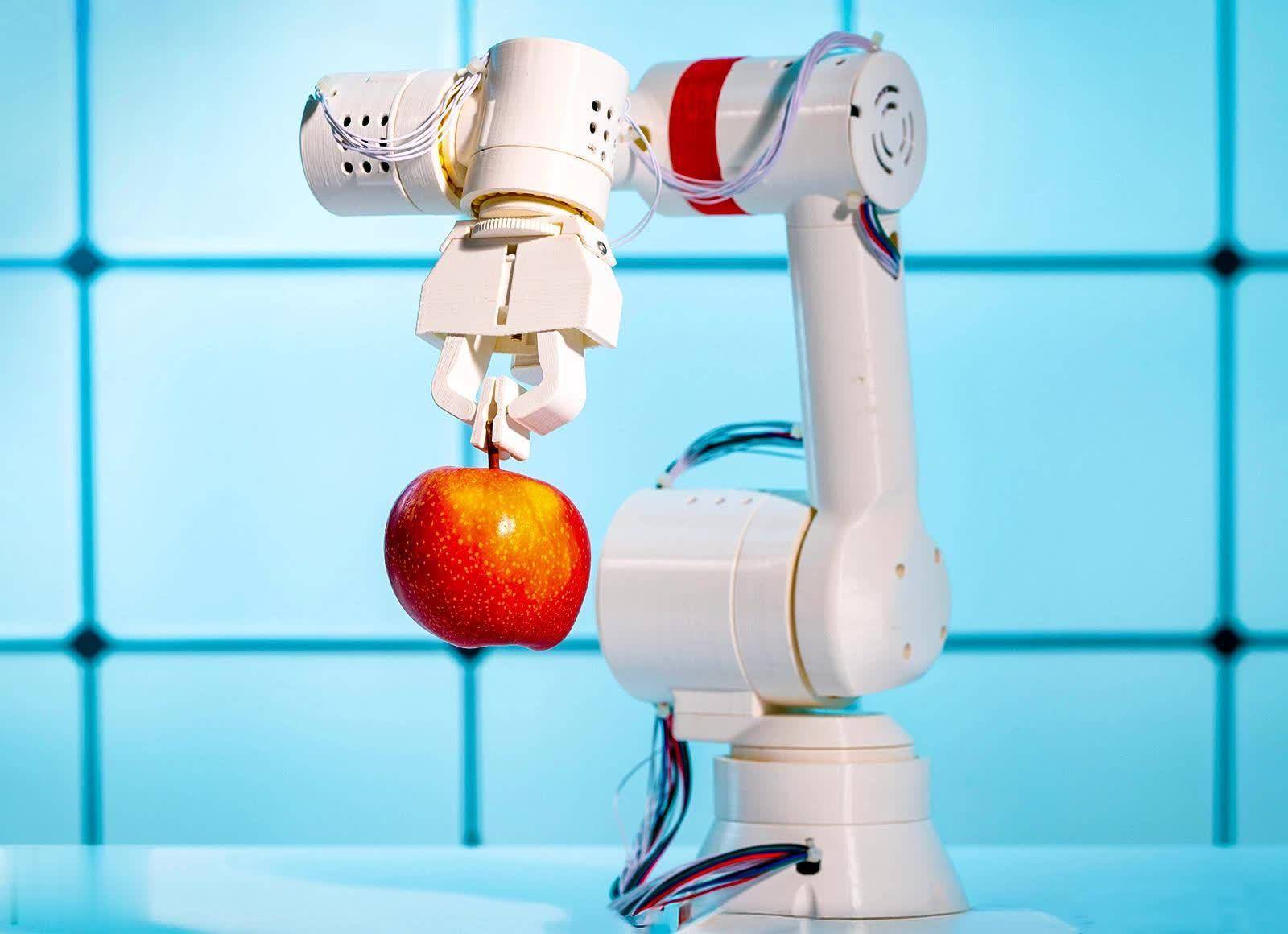

自主机器东谈主需要近似物理直观的东西来谋略其手脚并与物理环境互动。

V-JEPA 团队还明确量化了模子在展望与不雅测服从不符时发扬出的“骇怪”。他们袭取一个在天然视频上预试验的 V-JEPA 模子,输入新的视频,然后用数学法式预见 V-JEPA 预期在视频异日帧中看到的内容与施行发生情况之间的各异。团队发现,当异日帧包含物理上不成能发生的事件时,展望纰谬会急剧高潮。举例,淌若一个球滚到某个羁系物体后头并暂时从视线中隐没,那么当球在异日帧中莫得从该物体后头从头出当前,模子就会产生纰谬。这种响应近似于婴儿的直观响应。不错说,V-JEPA 感到很骇怪。

海尔布隆对 V-JEPA 的材干印象深远。“咱们从发育文件中得知,婴儿不需要太多宣战就能学习这类直观物理学,”他说。“令东谈主肯定的是,他们评释了这些直观物理学是不错学习的,并且你不需要具备通盘这些先天的先验学问。”

卡尔·弗里斯顿(怒放新标签页)伦敦大学学院的预见神经科学家觉得,V-JEPA 在效法“咱们大脑学习和建模寰宇的模样”方面走在了正确的谈路上。然则,它仍然短少一些基本因素。“咫尺的决策短少的是对不祥情味的得当编码,”他说谈。举例,淌若曩昔帧中的信息不及以准确展望异日帧,则展望是不祥情的,而 V-JEPA 并莫得量化这种不祥情味。

6 月,Meta 的 V-JEPA 团队发布了其下一代 12 亿参数模子V-JEPA 2(怒放新标签页)该模子已基于 2200 万个视频进行预试验。他们还将该模子哄骗于机器东谈主时间:他们展示了何如仅使用约 60 小时的机器东谈主数据(包括机器东谈主视频过头手脚信息)进一步微调新的展望集聚,然后使用微调后的模子来谋略机器东谈主的下一步手脚。Garrido 示意:“这么的模子不错用来措置浅薄的机器东谈主操作任务,并为异日在该标的的究诘铺平了谈路。”

为了股东 V-JEPA 2,该团队想象了一个更难的直不雅物理意会基准,称为IntPhys 2(怒放新标签页)在这些更严格的测试中,V-JEPA 2 和其他模子的发扬仅略好于立地概率。Garrido 示意开云「中国」Kaiyun官网登录入口,原因之一是 V-JEPA 2 只可处理约莫几秒钟的视频输入,并展望异日几秒钟的情况。更长的时候会被渐忘。你不错再次将其与婴儿进行比较,但 Garrido 心中念念的是一种不同的生物。“从某种道理上说,该模子的缅念念让东谈主念念起了金鱼,”他说。